Njerëzit i zgjidhin problemet e reja lehtësisht pa ndonjë trajnim apo praktikë të veçantë duke i krahasuar me probleme të njohura dhe duke e menduar “automatikisht” për zgjidhjen e problemit të ri. Ai proces, i njohur si arsyetimi analogjik, është menduar prej kohësh të jetë një aftësi unike vetëm për njerëzit.

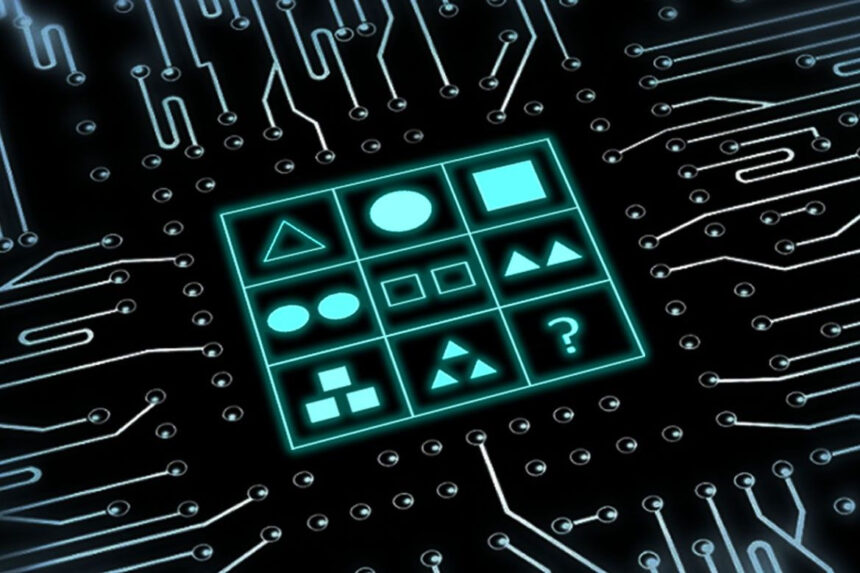

Por tani ekziston mundësia që inteligjenca artificiale të arsyetojë po aq mirë sa njerëzit. Studimet nga psikologët e UCLA tregojnë se, çuditërisht, modeli i gjuhës së inteligjencës artificiale GPT-3 performon po aq mirë sa studentët e universitetit kur u kërkohet të zgjidhin problemet e arsyetimit që zakonisht shfaqen në testet e inteligjencës dhe testet e standardizuara si SAT. Studimi është publikuar në Nature Human Behaviour.

Por autorët e studimit shkruajnë se studimi ngre pyetjen: A po imiton GPT-3 arsyetimin njerëzor si një nënprodukt i të dhënave të tij masive të trajnimit gjuhësor apo po përdor një lloj thelbësisht të ri të procesit kognitiv? Pa akses në funksionet e brendshme të GPT-3 – të cilat ruhen nga OpenAI, kompania që e krijoi atë – shkencëtarët e UCLA nuk mund të thonë me siguri se si funksionojnë aftësitë e arsyetimit të GPT-3.

Ata gjithashtu shkruajnë se megjithëse GPT-3 performon shumë më mirë nga sa prisnin në disa detyra arsyetimi, mjeti popullor i AI ende dështon në mënyrë spektakolare në të tjerat. “Pavarësisht se sa mbresëlënëse janë rezultatet tona, është e rëndësishme të theksojmë se ky sistem ka kufizime të mëdha,” tha Taylor Webb, një studiues në UCLA për psikologji dhe autori i parë i studimit. “Ai mund të bëjë arsyetim analogjik, por nuk mund të bëjë gjëra që janë shumë të lehta për njerëzit, si p.sh. përdorimi i mjeteve për të zgjidhur një detyrë fizike. Kur i dhamë ato lloj problemesh – disa prej të cilave fëmijët mund t’i zgjidhin shpejt – gjërat që sugjeroi ishin të pakuptimta.”