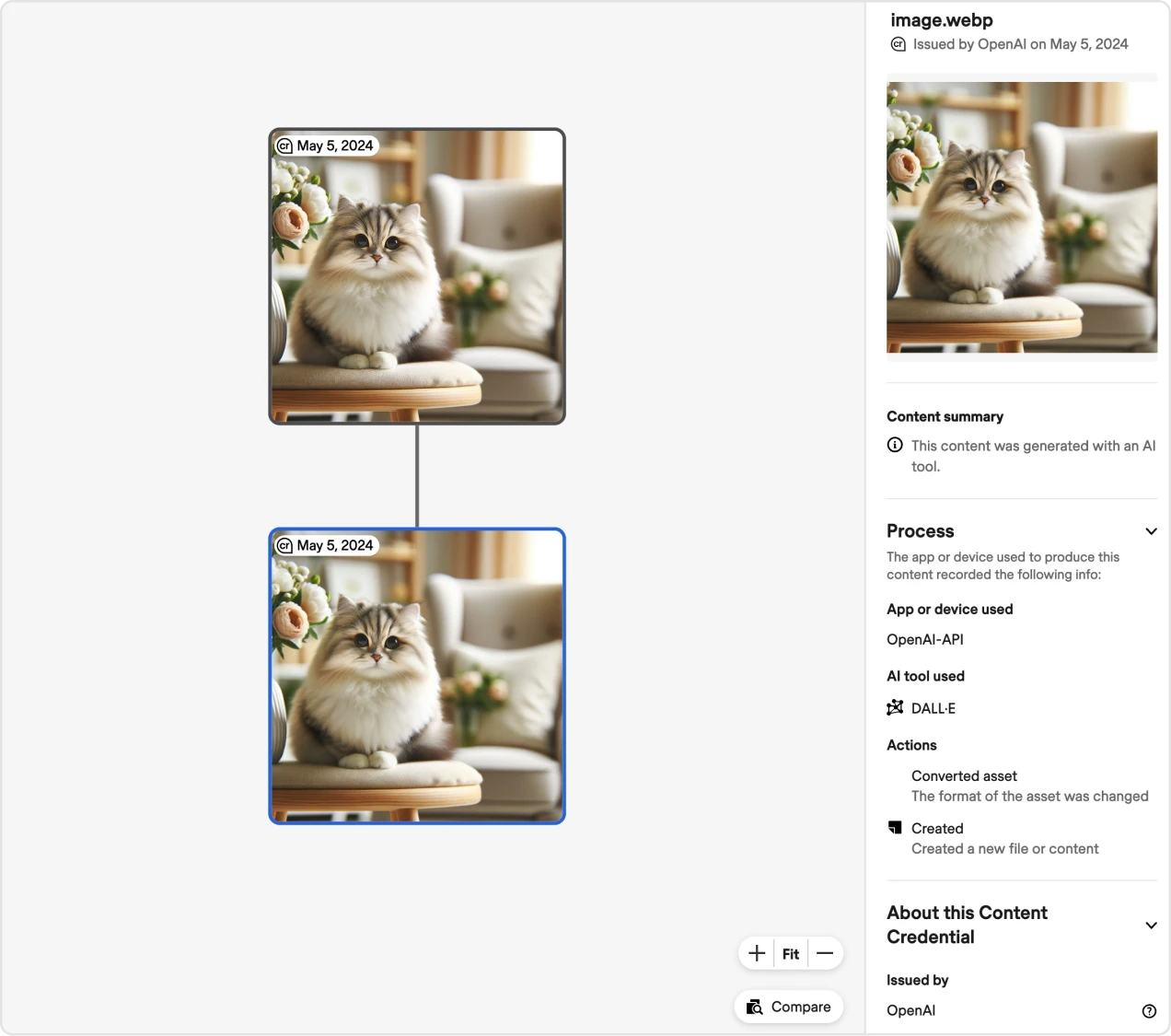

OpenAI ka prezantuar një mjet të ri për të zbuluar nëse një imazh është krijuar nga gjeneruesi i tij i imazheve DALL-E AI, si dhe metoda të reja që do të tregojnë më qartë përmbajtjen e krijuar nga inteligjenca artificiale.

Në një postim në blog, OpenAI njoftoi se ka filluar të zhvillojë metoda të reja për të gjurmuar përmbajtjen dhe për të provuar nëse ato janë të krijuar nga AI. Këto përfshijnë një mjet të ri klasifikues që përdor AI për të përcaktuar nëse fotografia është krijuar nga AI, si dhe një watermark rezistent ndaj editimeve që mund të etiketojë përmbajtjen me sinjale të padukshme.

Klasifikuesi parashikon mundësinë që një fotografi të jetë krijuar nga DALL-E 3. OpenAI pretendon se klasifikuesi funksionon edhe nëse imazhi është i prerë ose nëse përmasat apo ngjyrat janë ndryshuar. Ndërsa mjeti mund të zbulojë nëse imazhet janë bërë me DALL-E 3 me rreth 98% saktësi, performanca e tij për të kuptuar nëse përmbajtja vjen nga modele të tjera të AI nuk është aq e mirë, duke shënuar vetëm 5 deri në 10% të fotografive nga gjeneruesit e tjerë të imazheve, si Midjourney.

Kompania e inteligjencës artificiale filloi gjithashtu të shtojë watermark identifikues në klipe nga Voice Engine, platforma e saj text-to-speech aktualisht në testim të kufizuar.

Si klasifikuesi i imazhit ashtu edhe sinjalet treguese janë ende duke u përmirësuar. OpenAI thotë se duhet të marrë reagime nga përdoruesit për të testuar efektivitetin e tij. Studiuesit dhe grupet jofitimprurëse të gazetarisë mund të testojnë klasifikuesin e zbulimit të imazheve duke e aplikuar atë në platformën e qasjes kërkimore të OpenAI.