Startup-i Thinking Machines, i themeluar nga ish-CTO e OpenAI, Mira Murati, ka prezantuar produktin e tij të parë të quajtur Tinker, një API e dedikuar për trajnimin e modeleve të mëdha gjuhësore. Qëllimi i Tinker është të lehtësojë ndërtimin e modeleve open source, edhe për ekipe që nuk kanë akses në burime të mëdha kompjuterike. Platforma është menduar për studiues dhe zhvillues që duan të trajnojnë ose përshtatin modele ekzistuese pa u marrë me menaxhimin kompleks të infrastrukturës.

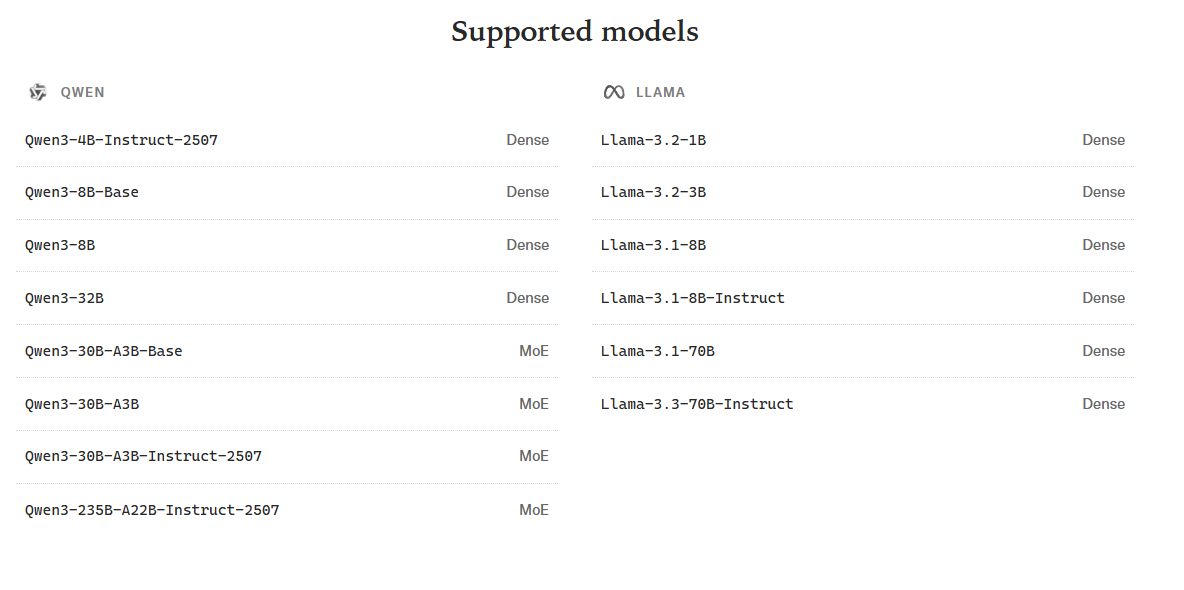

Në fazën fillestare, Tinker mbështet modele të hapura nga Meta (Llama) dhe Alibaba (Qwen), përfshirë variante të mëdha si Qwen-235B-A22B. Ndërrimi midis modeleve bëhet thjesht duke ndryshuar një varg të vetëm në kod. Shërbimi kujdeset për menaxhimin e burimeve, tolerancën ndaj gabimeve dhe planifikimin e ngarkesës.

Tinker përdor teknologjinë LoRA (Low-Rank Adaptation), e cila lejon që disa trajnime të zhvillohen paralelisht në të njëjtën pajisje, duke ulur kostot dhe duke rritur efikasitetin. Platforma ofron gjithashtu Tinker Cookbook, një bibliotekë e hapur me metoda standarde për periudhën pas-trajnimit, e krijuar për të shmangur gabimet më të zakonshme gjatë përshtatjes së modeleve.

Aktualisht, Tinker ndodhet në fazë beta të mbyllur dhe është falas për përdoruesit që bashkohen në listën e pritjes, ndërsa çmimet në bazë të përdorimit pritet të zbatohen në javët e ardhshme.

Me këtë projekt, Murati dhe ish-kolegët e saj nga OpenAI – përfshirë John Schulman, Barret Zoph dhe Luke Metz – tregojnë besimin se modelet e hapura të përshtatura mund të jenë më fleksibël dhe ekonomikisht më të leverdisshme sesa modelet e mbyllura si GPT-5.