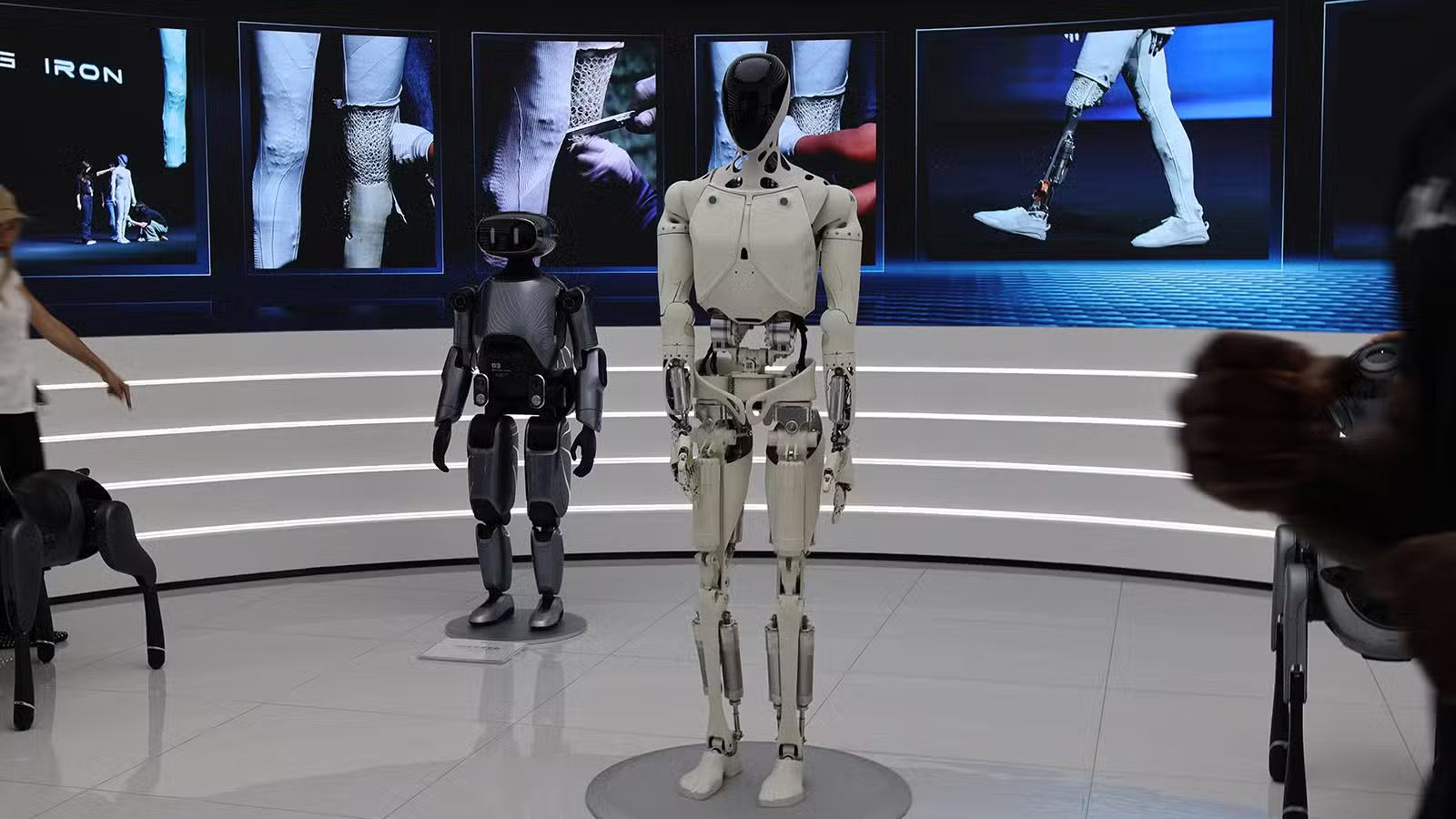

Si pjesë e strategjisë dixhitale, BE dëshiron të rregullojë inteligjencën artificiale (AI) për të siguruar kushte më të mira për zhvillimin dhe përdorimin e kësaj teknologjie inovative.

Në prill 2021, Komisioni Evropian propozoi strukturën e parë rregullatore të BE-së për AI. Në të thuhej se sistemet e AI që mund të përdoren në aplikacione të ndryshme duhet të analizohen dhe klasifikohen sipas rrezikut që paraqesin për përdoruesit. Nivelet e ndryshme të rrezikut do të përcaktojnë një rregullim më të lehtë ose më të fortë.

Prioriteti i Parlamentit është të sigurohet që sistemet e AI të përdorura në BE të jenë të sigurta, transparente, të gjurmueshme, jodiskriminuese dhe miqësore me mjedisin. Sistemet e AI duhet të mbikëqyren nga njerëzit, në vend të automatizimit, për të parandaluar rezultate të dëmshme.

Rrezik i papranueshëm

Sistemet e AI me një rrezik të papranueshëm janë sisteme që konsiderohen si kërcënim për njerëzit dhe do të ndalohen. Ato përfshijnë:

- Manipulimi kognitiv i sjelljes së njerëzve ose grupeve specifike të cenueshme: për shembull lodra të aktivizuara me zë që inkurajojnë sjellje të rrezikshme tek fëmijët

- Vlerësimi social: klasifikimi i njerëzve në bazë të sjelljes, statusit socio-ekonomik ose karakteristikave personale

- Sistemet e identifikimit biometrik në kohë reale dhe në distancë, të tilla si njohja e fytyrës

Mund të lejohen disa përjashtime: Për shembull, sistemet të identifikimit biometrik të mëvonshëm në distancë ku identifikimi ndodh pas një kohe të konsiderueshme do të lejohen të përdoren në hetmiet për krimet e rënda, por vetëm pas miratimit të gjykatës.

Rrezik i lartë

Sistemet e AI që ndikojnë negativisht në sigurinë ose të drejtat themelore do të konsiderohen me rrezik të lartë dhe do të ndahen në dy kategori:

1) Sistemet e AI që përdoren në produktet që janë në përputhje me legjislacionin e BE-së për sigurinë e produkteve. Këtu përfshihen lodrat, aviacioni, makinat, pajisjet mjekësore dhe ashensorët.

2) Sistemet e AI që përfshihen në tetë fusha specifike që do të duhet të regjistrohen në një bazë të dhënash të BE-së:

- Identifikimi biometrik dhe kategorizimi i personave fizikë

- Menaxhimi dhe funksionimi i infrastrukturave kritike

- Arsimi dhe formimi profesional

- Punësimi, menaxhimi i punëtorëve dhe aksesi në vetëpunësim

- Qasja në shërbimet thelbësore private, shërbimet publike dhe përfitimet publike

- Zbatimi i ligjit

- Menaxhimi i migrimit, azilit dhe kontrollit kufitar

- Ndihmë në interpretimin dhe zbatimin ligjor të ligjit.

Të gjitha sistemet e AI me rrezik të lartë do të vlerësohen përpara se të hidhen në treg dhe gjithashtu gjatë gjithë ciklit të tyre të jetës.

AI gjeneruese

Inteligjenca artificiale gjeneruese, si ChatGPT, do të duhet të përputhet me kërkesat e transparencës:

- Duhet treguar qartë se përmbajtja është krijuar nga AI

- Dizenjimi i modelit për të parandaluar që AI të gjenerojë përmbajtje të paligjshme

- Publikimi i një përmbledhje e të dhënave me të drejtë autori të përdorura për trajnim

Rrezik i kufizuar

Sistemet e inteligjencës artificiale me rrezik të kufizuar duhet të përputhen me kërkesat minimale të transparencës që do t’i lejojnë përdoruesit të marrin vendime të informuara. Pas ndërveprimit me aplikacionet, përdoruesi mund të vendosë nëse dëshiron të vazhdojë ta përdorë atë. Përdoruesit duhet të ndërgjegjësohen kur ndërveprojnë me AI. Kjo përfshin sistemet e AI që gjenerojnë ose manipulojnë përmbajtjen e imazhit, audio ose video, për shembull deepfakes.

Hapat e ardhshëm

Më 14 qershor 2023, eurodeputetët miratuan qëndrimin negociues të Parlamentit për Aktin e AI. Bisedimet do të fillojnë tani me vendet e BE-së në Këshill për formën përfundimtare të ligjit. Synimi është të arrihet një marrëveshje deri në fund të këtij viti.